Deepfake audio : quand l'intelligence artificielle manipule notre ouïe

Les deepfakes, ces vidéos truquées grâce à l'intelligence artificielle, ne se contentent plus de tromper nos yeux. Désormais, ils s'attaquent également à notre ouïe.

Des cas récents, comme celui d'un appel téléphonique imitant la voix de Joe Biden pour dissuader les électeurs du New Hampshire, ou d'une fausse conversation compromettante impliquant la journaliste slovaque Monika Tódová, illustrent le danger grandissant de cette nouvelle forme de désinformation.

Comment fonctionnent les deepfakes audio ?

Grâce aux progrès des algorithmes de synthèse vocale et de clonage de voix, il est possible de créer de faux enregistrements audio extrêmement réalistes, à partir de courts échantillons de voix. Ces deepfakes peuvent ensuite être diffusés sur les réseaux sociaux ou par d'autres moyens pour tromper le public.

Pourquoi sont-ils dangereux ?

Les deepfakes audio peuvent avoir de graves conséquences sur la vie des individus et sur la société en général. Ils peuvent être utilisés pour :

- Diffuser de fausses informations et de la propagande

- Porter atteinte à la réputation des personnes

- Manipuler des élections

- Inciter à la violence ou à la haine

Comment se protéger ?

Il n'existe pas de solution miracle pour se protéger des deepfakes audio. Cependant, il existe quelques mesures que vous pouvez prendre pour réduire votre risque d'être trompé :

- Soyez critique vis-à-vis des informations que vous recevez, en particulier si elles proviennent de sources inconnues ou non fiables.

- Prêtez attention à l'incohérence des propos ou à des éléments qui semblent suspects.

- Vérifiez les sources d'information et comparez les versions de l'histoire.

- Utilisez des outils de détection de deepfakes, bien qu'ils ne soient pas encore infaillibles.

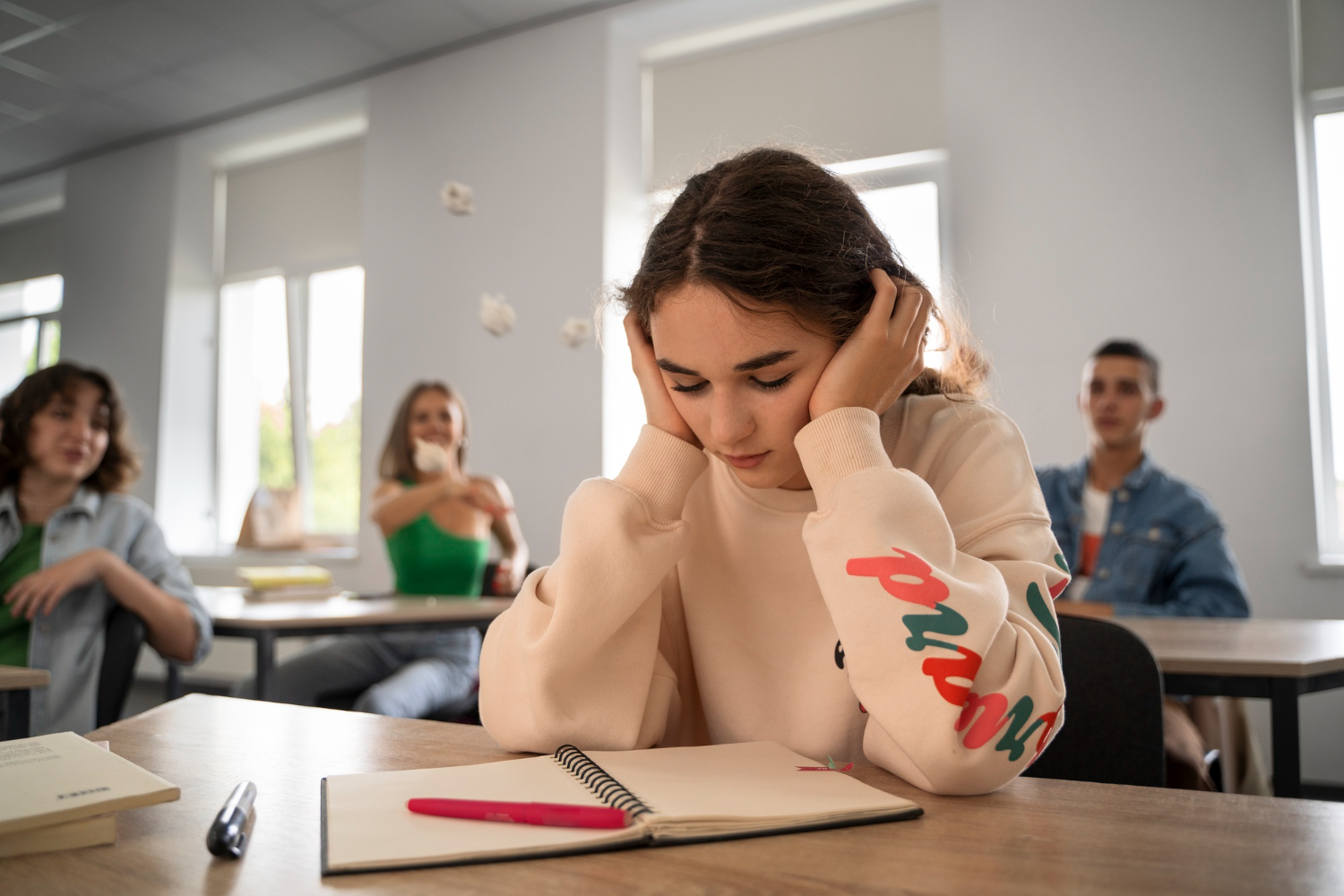

L'éducation aux médias est essentielle

Il est important de sensibiliser le public aux dangers des deepfakes audio et de leur apprendre à identifier les informations fausses. Les enseignants, les journalistes et les autres acteurs de la société civile ont un rôle crucial à jouer à cet égard.

En conclusion, les deepfakes audio constituent une nouvelle menace sérieuse pour notre démocratie et notre société. Il est important que nous soyons conscients de ce danger et que nous prenions des mesures pour nous en protéger.

En plus des points abordés dans l'article original, voici quelques éléments supplémentaires que vous pourriez inclure dans votre reformulation :

- Des exemples concrets de deepfakes audio récents et de leurs impacts.

- Des interviews d'experts sur les deepfakes audio et les moyens de les combattre.

- Des ressources pour en savoir plus sur les deepfakes audio.

SOURCE : THECONVERSATION

Nos réalisations

Découvrez nos références, nos réalisations et nos travaux pour des établissements.

C'est tout frais de nos experts

ChatGPT Ads : fonctionnement, prix et stratégie pour les établissements d’éducation

Santé mentale : des rendez-vous en 24 à 48 heures promis pour les élèves « repérés »