L’intelligence artificielle dans l’enseignement supérieur : un atout à encadrer avec précaution

L’essor des outils d’intelligence artificielle générative bouscule l’enseignement supérieur, tant pour les étudiants que pour les enseignants. À l’université Paris-I Panthéon-Sorbonne, Jean-François Caulier, ancien vice-président en charge de la stratégie et des innovations numériques, analyse cette transformation et met en garde contre certaines dérives.

L’IA, d’abord perçue avec scepticisme, devient incontournable

L’arrivée de ChatGPT en 2022 a marqué un tournant. Les étudiants se sont rapidement approprié l’outil, alors que les enseignants ont, dans un premier temps, manifesté une certaine méfiance.

"Au départ, les étudiants utilisaient ces outils en secret, principalement pour automatiser leurs devoirs. Aujourd’hui, les usages sont mieux assumés, allant de l’aide à la structuration d’idées à la correction et à la traduction."

Pour accompagner cette évolution, l’université a lancé en janvier 2023 un Appel à Manifestation d’Intérêt (AMI) sur l’IA et la pédagogie, renouvelé chaque semestre. Objectif : encourager les enseignants à expérimenter l’IA tout en recueillant leurs retours.

Cette initiative a connu un succès croissant, avec une vingtaine de projets retenus entre 2023 et 2024.

Des expérimentations pédagogiques prometteuses

Les premiers retours d’expérience ont permis d’identifier deux grandes tendances :

1️⃣ Les IA génératives ne remplacent pas l’expertise humaine, et leur efficacité reste variable.

2️⃣ Elles sont utiles pour développer l’esprit critique des étudiants, notamment en leur faisant confronter leurs propres travaux aux réponses générées par l’IA.

Un exemple marquant est celui de Jean-Marie Dallet, professeur à l’école des arts de la Sorbonne. Il a demandé à ses étudiants de combiner plusieurs outils d’IA pour créer des œuvres artistiques originales.

"Loin de se contenter d’une simple requête à une IA, ils ont utilisé une vingtaine d’outils différents pour affiner leurs créations, ce qui a donné lieu à une vraie réflexion sur le processus créatif."

Pour Jean-François Caulier, l’IA doit être vue comme un amplificateur de productivité :

"Ces outils ne remplacent pas la réflexion, mais permettent d’accélérer certaines tâches. Toutefois, ils nécessitent des compétences solides pour être utilisés efficacement."

Former les étudiants à un usage raisonné de l’IA

Dans un monde où l’IA s’impose dans de nombreux secteurs professionnels, l’université doit préparer ses étudiants à un double défi :

✔ Savoir travailler sans IA, afin de développer des compétences fondamentales.

✔ Maîtriser ces outils intelligemment, en fonction des exigences du marché du travail.

Cette approche varie selon les disciplines :

🔹 En droit, il est essentiel d’acquérir une solide capacité d’analyse avant de recourir à l’IA.

🔹 En informatique, l’apprentissage du code passe désormais par ces outils, qui permettent de progresser plus rapidement.

"Comme avec la calculatrice en mathématiques, il faut savoir travailler sans IA, mais aussi apprendre à l’utiliser efficacement."

L’université refuse d’accorder des accès aux IA génératives payantes

Face à la montée en puissance des IA, de nombreux enseignants demandent un accès à ChatGPT Plus ou à d’autres solutions avancées. Pourtant, l’université refuse systématiquement ces demandes, pour plusieurs raisons :

❌ Coût exorbitant : Un abonnement institutionnel reviendrait à 300 000 dollars par mois pour l’université.

❌ Risque de fuite des données : L’IA peut collecter des informations sensibles, notamment dans le cadre de la recherche et des dossiers étudiants.

❌ Non-conformité avec le RGPD : Les Gafam restent opaques sur l’usage des données des utilisateurs.

"Nous ne pouvons pas nous permettre de partager nos données avec des entreprises dont les pratiques restent floues."

L’université mise plutôt sur des solutions alternatives et sécurisées, notamment à travers la fédération Ilaas, qui développe une IA mutualisée et respectueuse des réglementations européennes.

Un recours incontrôlé aux IA dans les laboratoires de recherche

Malgré ces restrictions, certains enseignants-chercheurs contournent l’interdiction en sollicitant leur laboratoire ou leur composante, qui disposent de budgets propres pour financer ces outils.

🔹 Un manque de contrôle : Les universités constatent ces dépenses, mais ne peuvent les empêcher.

🔹 Des risques en cybersécurité : Des logiciels non validés sont installés sur des équipements institutionnels.

Face à cette réalité, Jean-François Caulier appelle à une formation adaptée pour tous :

"Nous devons former étudiants, enseignants et administrateurs à un usage éclairé de l’IA. Sans cela, nous risquons de perdre le contrôle de ces outils et de leurs implications."

Conclusion : intégrer l’IA sans perdre de vue les fondamentaux

L’intelligence artificielle est un outil puissant qui révolutionne l’apprentissage et la recherche. Mais pour en tirer pleinement parti, il est essentiel de l’encadrer et de sensibiliser les utilisateurs aux risques qu’elle comporte.

L’université Paris-I Panthéon-Sorbonne mise sur une approche raisonnée, favorisant les expérimentations pédagogiques tout en protégeant les données sensibles. À terme, cette stratégie pourrait servir de modèle pour d’autres établissements, cherchant à équilibrer innovation et responsabilité numérique.

SOURCE : AEFINFO

Nos réalisations

Découvrez nos références, nos réalisations et nos travaux pour des établissements.

C'est tout frais de nos experts

ChatGPT Ads : fonctionnement, prix et stratégie pour les établissements d’éducation

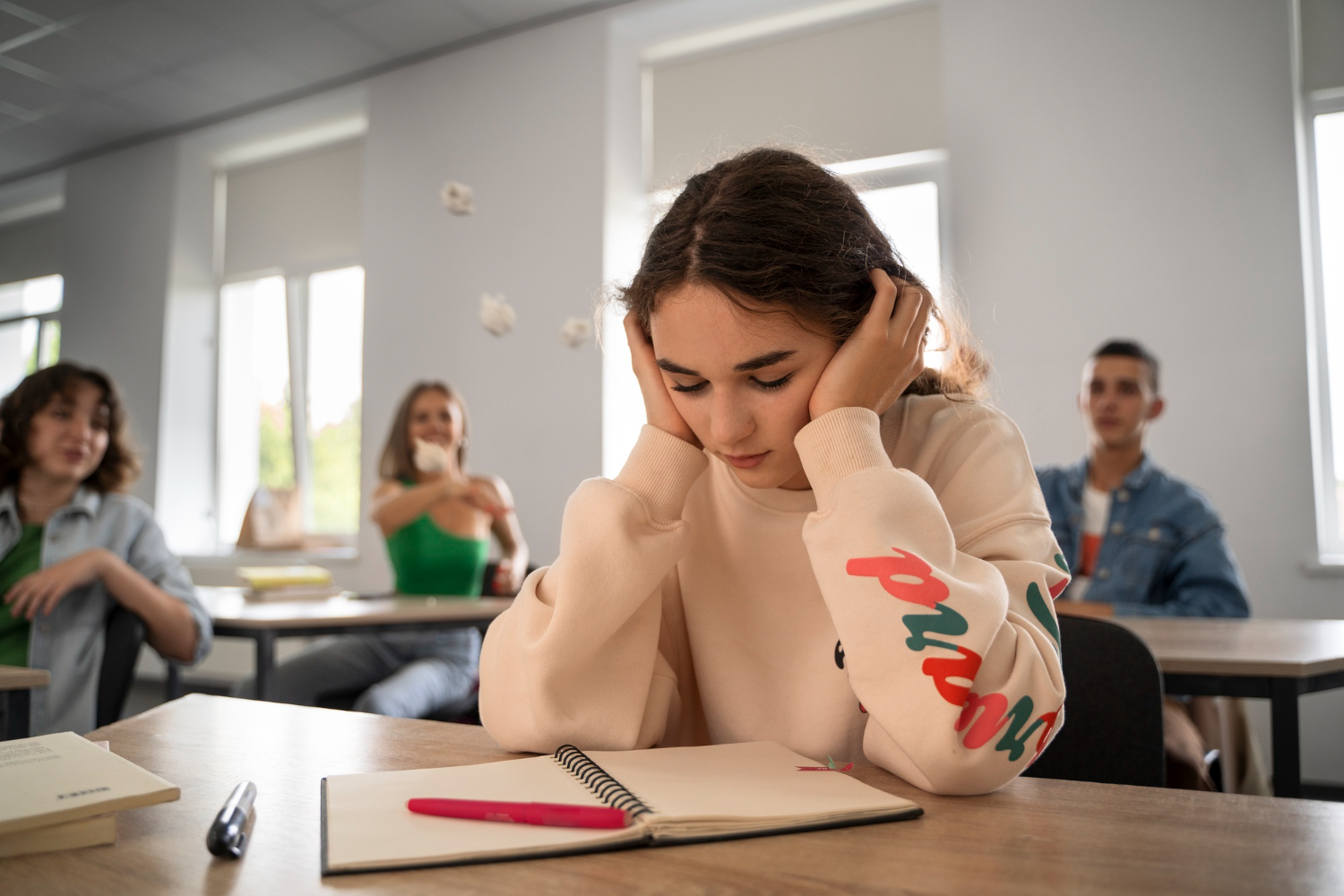

Santé mentale : des rendez-vous en 24 à 48 heures promis pour les élèves « repérés »