Doit-on ralentir les recherches sur l'intelligence artificielle ? Les perspectives du professeur Claude Frasson

En mai dernier, 350 experts, parmi lesquels le professeur Yoshua Bengio, une figure de proue du deep learning en intelligence artificielle, ont publié une lettre mettant en garde contre le risque d'extinction de l'humanité lié à l'IA. Un risque comparé aux menaces des pandémies et de la guerre nucléaire. Pourquoi cette inquiétude ? Les machines sont-elles sur le point de surpasser les humains intellectuellement, menant à une scène digne de science-fiction ? Claude Frasson, professeur honoraire en science informatique à l'université de Montréal, spécialisé en IA et neurosciences, donne des réponses éclairantes.

Éthique et avertissements :

Alors pourquoi cette mise en garde ? "Yoshua Bengio préconise un ralentissement de la recherche sur l’IA générative qui produit des textes, des images, des applications, du code informatique, des scénarios artistiques... et des émotions", explique Claude Frasson.À l’instar des robots émotionnels capables d’analyser et d’encourager des sentiments positifs, "très utiles chez les patients atteints d’Alzheimer auprès de qui nous avons pu réaliser des expériences concluantes visant à réduire les émotions négatives". Et d’insister : "On ne peut pas créer des intelligences artificielles qui ont des émotions propres. En revanche, elles peuvent les détecter sur un visage, les analyser et en simuler chez les humains à travers des personnages virtuels. Cela peut être, par exemple, le désir d’acheter un produit..." Jusque-là, rien de bien méchant. Si ce n’est qu’on assiste actuellement à une course entre OpenIA [l’entreprise qui a créé ChatGPT, ndlr], Google, Microsoft et Meta qui investissent des sommes pharamineuses pour créer des plateformes émotionnelles "avec le visage et la voix de stars ou de personnes connues, explique le professeur. Le problème, c’est qu’il s’agit d’informations générées et qu’on ne peut pas faire la différence entre un influenceur émotionnel réel et virtuel. Avec, cette année, les élections présidentielles américaines, nous allons assister à une bataille pour provoquer des émotions" et influer sur les votes par exemple... "Il est nécessaire que les humains contrôlent ces outils. Surtout, ils doivent vérifier la véracité des informations, qu’ils ne les acceptent pas passivement en développant un esprit critique."

SOURCE : https://www.varmatin.com/economie/faut-il-ralentir-la-recherche-sur-lintelligence-artificielle-900918

Claude Frasson rassure en affirmant que ce scénario n'est pas imminent. Il souligne que l'intelligence humaine, contrairement à celle des machines, est intrinsèquement liée aux émotions et à la capacité de raisonner et de créer de nouvelles connaissances. Ce processus complexe, impliquant des composants tels que l'amygdale et l'hippocampe, est actuellement au-delà des capacités des ordinateurs.

Claude Frasson explique que Bengio recommande de ralentir la recherche sur l'IA générative, qui produit des textes, des images, des applications, du code informatique, des scénarios artistiques, et même des émotions. La crainte est que ces technologies, notamment les robots émotionnels, puissent être utilisées à des fins de manipulation, influant par exemple sur les émotions des électeurs. Il souligne l'importance d'un contrôle humain sur de telles technologies et de la vérification de la véracité des informations générées.

Nos réalisations

Découvrez nos références, nos réalisations et nos travaux pour des établissements.

C'est tout frais de nos experts

ChatGPT Ads : fonctionnement, prix et stratégie pour les établissements d’éducation

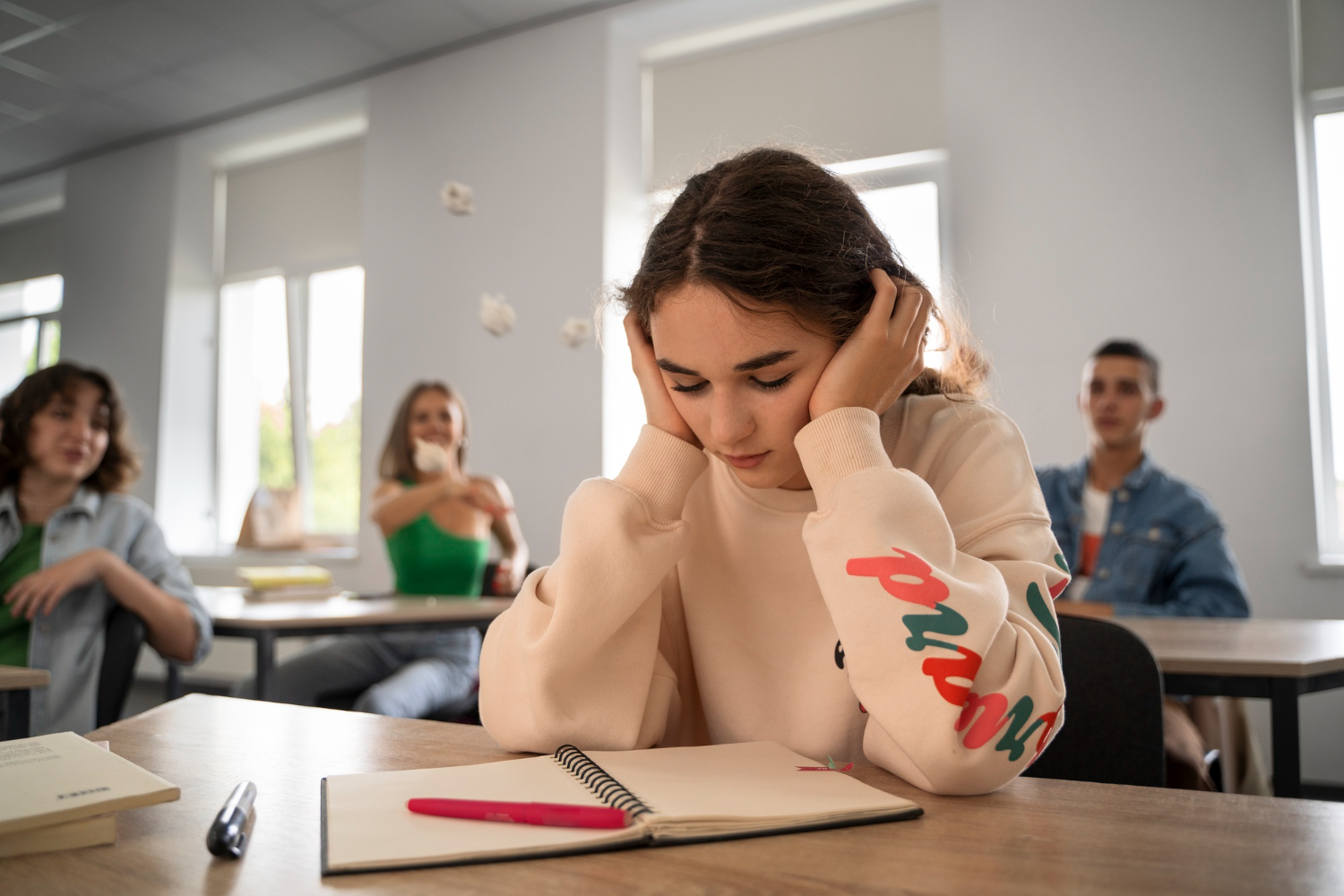

Santé mentale : des rendez-vous en 24 à 48 heures promis pour les élèves « repérés »